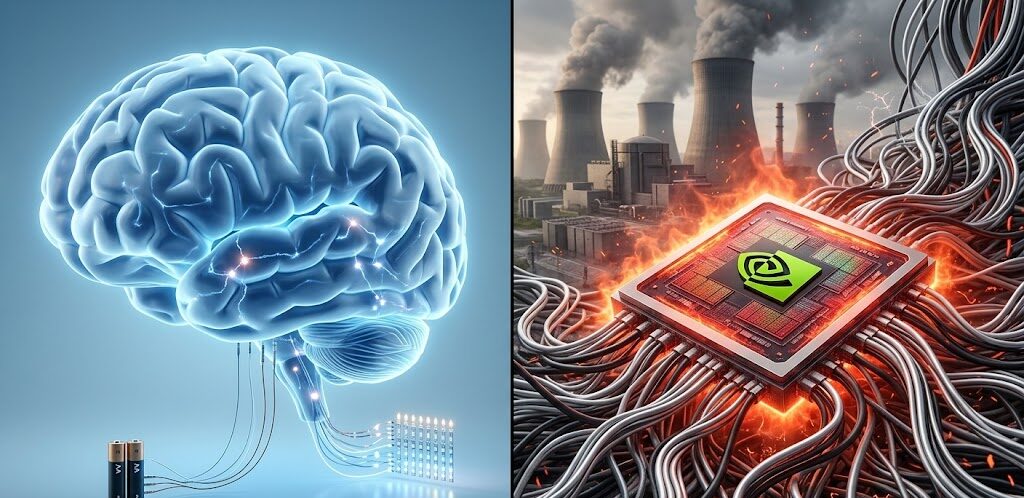

En la carrera por alcanzar la Inteligencia Artificial General (AGI), las empresas tecnológicas están construyendo infraestructuras que consumen la energía de ciudades enteras. Los centros de datos modernos, equipados con miles de unidades de procesamiento gráfico de última generación, requieren sistemas de refrigeración masivos y una alimentación eléctrica constante que pone en jaque la sostenibilidad del planeta. Sin embargo, en el interior de tu cráneo, existe una máquina que realiza tareas de reconocimiento, lenguaje y razonamiento mucho más complejas con apenas una fracción de ese coste energético.

La comparativa es, sencillamente, ridícula desde el punto de vista de la ingeniería. Mientras que un superordenador necesita megavatios para simular una fracción de la actividad neuronal, el órgano humano opera con la energía equivalente a una bombilla LED de bajo consumo. Esta brecha abismal en la eficiencia cerebro vs IA es el gran misterio que la neurotecnología intenta resolver. El silicio es rápido y preciso, pero la biología ha perfeccionado durante millones de años un sistema de procesamiento paralelo y adaptable que hace que los mejores chips de NVIDIA parezcan calefactores ineficientes.

En este artículo vas a encontrar:

- El análisis del consumo energético: 20 vatios frente a granjas de servidores.

- Diferencias entre el procesamiento en serie de los chips y el procesamiento paralelo biológico.

- Qué es la computación neuromórfica y cómo pretende imitar a las neuronas.

- La plasticidad sináptica como ventaja competitiva del ser humano.

- El futuro de los procesadores sostenibles inspirados en la naturaleza.

Los 20 vatios de potencia que ridiculizan a los centros de datos

El cerebro humano es el objeto más complejo del universo conocido y, sorprendentemente, funciona con unos **20 vatios de potencia**. Esta energía es suficiente para gestionar billones de sinapsis simultáneas, procesar estímulos sensoriales en tiempo real y generar conciencia. Por el contrario, entrenar un modelo de lenguaje de gran tamaño (como GPT-4) consume tanta electricidad como cientos de hogares españoles durante un año. Esta disparidad en la eficiencia cerebro vs IA se debe a que nuestras neuronas no necesitan estar «encendidas» todo el tiempo; solo se activan cuando es estrictamente necesario mediante pulsos eléctricos discretos.

Los procesadores actuales, incluidos los potentes H100 de NVIDIA, operan bajo la arquitectura de Von Neumann, donde los datos deben viajar constantemente entre el procesador y la memoria. Este movimiento de información genera un calor inmenso y una pérdida de eficiencia brutal. En el cerebro, el procesamiento y el almacenamiento ocurren en el mismo lugar (las sinapsis), eliminando el «cuello de botella» que lastra a la tecnología actual. Esta es la razón por la que, aunque la IA reciba inversiones millonarias, todavía estamos lejos de replicar la elegancia energética de la biología.

La eficiencia no solo es una cuestión de ahorro, sino de capacidad de aprendizaje. Un niño puede aprender a identificar un animal tras verlo una sola vez; una IA necesita miles de imágenes etiquetadas y una potencia de cálculo masiva para alcanzar la misma precisión. Esta «economía de datos» es intrínseca a la arquitectura neuronal. Mientras no cambiemos la forma en que los chips procesan la información, seguiremos dependiendo de infraestructuras energéticas insostenibles para lograr avances que la naturaleza ya resolvió con un poco de glucosa y oxígeno.

Computación neuromórfica: el intento de copiar el diseño biológico

Para cerrar la brecha en la eficiencia cerebro vs IA, la industria está explorando la computación neuromórfica. Se trata de diseñar chips que imitan físicamente la estructura de las redes neuronales, utilizando «neuronas de silicio» y «sinapsis artificiales». Estos dispositivos no funcionan con un reloj central que sincroniza todo el sistema (como un procesador normal), sino que son asíncronos: solo consumen energía cuando reciben un impulso o «pico» de información. Esta tecnología promete reducir el consumo de la IA en varios órdenes de magnitud, acercándonos a la posibilidad de tener asistentes inteligentes potentes dentro de dispositivos móviles sin agotar la batería.

La ventaja de estos chips inspirados en el cerebro es su capacidad para el aprendizaje continuo. Los sistemas actuales son estáticos: una vez entrenados, no cambian. El cerebro, en cambio, posee plasticidad, lo que le permite reconfigurarse ante nuevas experiencias. Esta característica es vital para la supervivencia y es lo que permite que nuestra memoria sea selectiva y eficiente. Si logramos integrar esta plasticidad en el hardware, la inteligencia artificial dejará de ser una herramienta rígida para convertirse en un sistema orgánico y adaptativo.

Empresas como Intel, con su chip Loihi, o diversos laboratorios de neurotecnología, están liderando este cambio de paradigma. El objetivo no es superar al cerebro en velocidad bruta (algo que el silicio ya hace), sino en inteligencia por vatio. La sostenibilidad de la tecnología del mañana depende de nuestra capacidad para dejar de «quemar» energía y empezar a utilizarla con la sabiduría de la evolución biológica. La computación neuromórfica no es solo una opción, es la única salida viable ante la crisis energética que se avecina con la expansión de la IA generativa.

Plasticidad sináptica frente a la rigidez del código

Uno de los mayores obstáculos para alcanzar la eficiencia cerebro vs IA es la falta de adaptabilidad del software. En el cerebro, cada pensamiento o aprendizaje altera físicamente las conexiones entre neuronas (un proceso llamado potenciación a largo plazo). En los chips de NVIDIA, los pesos de la red son números almacenados en una memoria que no cambia físicamente. Esta diferencia fundamental hace que el cerebro sea un sistema dinámico capaz de resolver problemas nuevos con recursos mínimos, mientras que la IA es excelente en tareas específicas pero torpe y costosa cuando se le saca de su zona de entrenamiento.

Además, el cerebro humano gestiona el ruido de forma magistral. Mientras que un pequeño error en un bit de memoria puede corromper un programa informático, el cerebro opera en un entorno caótico y ruidoso, siendo capaz de recuperar información incluso bajo condiciones adversas. Esta resiliencia es clave en nuestra supervivencia y está relacionada con la forma en que el cerebro procesa los sonidos y estímulos externos para filtrar lo que es relevante. La IA, por el contrario, requiere datos limpios y entornos controlados para no alucinar o fallar estrepitosamente.

En conclusión, la verdadera revolución no vendrá de hacer chips más grandes o centros de datos más potentes, sino de entender la arquitectura del pensamiento. El cerebro humano sigue siendo el estándar de oro de la eficiencia, un recordatorio humillante de que la naturaleza ya creó la supercomputadora perfecta hace eones. El camino hacia una tecnología consciente y sostenible pasa por dejar de competir contra la biología y empezar a aprender de ella, transformando los gigavatios de hoy en los milivatios del mañana.

🚀 ¿Te ha gustado?

No te pierdas lo próximo. Únete al canal de Telegram y recibe las curiosidades directo en tu móvil.

Unirme al Canal GRATIS